DeepSeek百度版 V1.0.7

5.0分

5.0分

- 本游戏:官方版安全无广告需网络

- 标签: 强大智能 高效准确 持续更新

- 更新时间:2026-02-11 01:41:04

- 相关软件

DeepSeek百度版是深度求索公司打造的一款AI智能工具,它也是国内首款自主研发的AI软件。此软件功能极为强大,依托先进的自然语言处理(NLP)技术,能够实现对文本内容的理解、分析以及高质量生成。此外,该软件适用于诸多场景,用户可依据自身需求自主挑选,为用户带来极为便捷的使用感受。

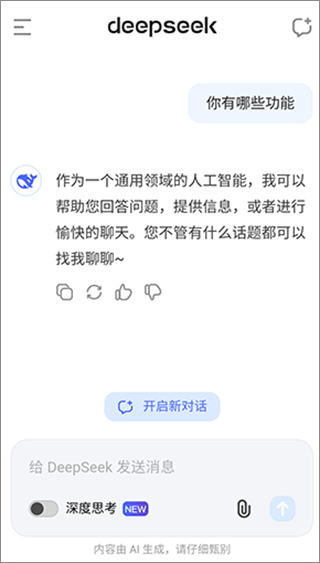

DeepSeek百度版怎么搜索内容?

点击中间的输入栏,输入我们想要知道的问题;

输入完毕以后点击发送,稍等片刻;

这个时候我们就可以获取相应的答案了。

如何真正用好DeepSeek百度版?

和 AI 打交道的核心关键在于“沟通”。AI

就像是一个被蒙住眼睛的天才,它懂很多,但无法直接感知这个世界。只有通过我们的描述,它才能理解现实世界的样子。

这就如同你在向一个从未目睹过大海的人形容海浪的声响。要是你仅仅说“哗啦哗啦”,对方或许会误以为是下雨的声音;可要是你表述为“仿佛无数庞大的丝绸在空中抖动”,那呈现出的画面感便截然不同。同理,与AI沟通也需要具备这般的“描述能力”。

与AI交流时,提示词就等同于你的“表达能力”。这就如同学习一门全新的语言,此能力唯有通过持续练习方可得到提升。即便是像Deepseek这般强大的AI,要是我们无法清晰表述自身需求,它也仅能给出含糊不明的回答。

另外,有一点极其关键,那便是AI的“幻觉”现象。它好似一位知识渊博,然而偶尔会不由自主“脑补”的友人。它或许会充满自信地虚构出并不存在的数据,也可能将毫无关联的信息牵强附会,亦或是生成看似合乎逻辑实则错误的内容。因此,我们必须成为AI幻觉的“执剑人”,始终保持警觉。

换句话说,AI

是一个强大的工具,但工具的使用效果取决于使用者的能力。通过不断练习和保持警惕,我们才能真正发挥AI的价值,同时避免掉入“幻觉”的陷阱。

那么,如何用好这个“AI 神器”呢?给大家分享几个技巧。

一、常规提问模版

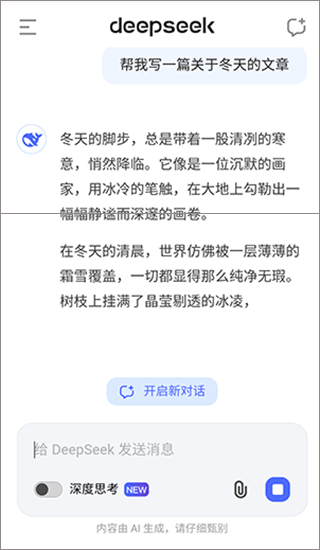

以往在与ChatGPT这类指令模型进行对话时,我们往往会运用颇为复杂的提示词模板。然而,DeepSeek有所不同,它更像是一位善于思考的伙伴,反倒是采用简单明晰的表达方式,能取得更好的效果。

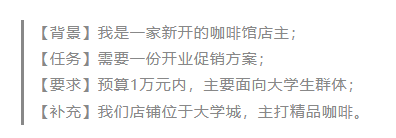

非常推荐这个简单但超级实用的“四步提问法”:背景 + 任务 + 要求 + 补充。举个例子:

这个方法的妙处在于:

这样提问不仅能让 DeepSeek

更好地理解你的需求,还能避免它理解偏差或者回答跑题。这就像和一个聪明的朋友交谈,你把情况说清楚了,他自然能给出更有针对性的建议。

记住,和 DeepSeek

对话,不需要太多花哨的技巧,保持简单清晰才是王道。它的推理能力很强,只要你把需求说明白,它就能理解你的意图,并给出令人惊喜的回答。

二、解复杂任务

现阶段 AI 由于上下文,模型能力等问题,其实在处理复杂任务的时候时常会出现“偷懒”这种情况,这种时候就需要我们帮 AI 拆解任务。

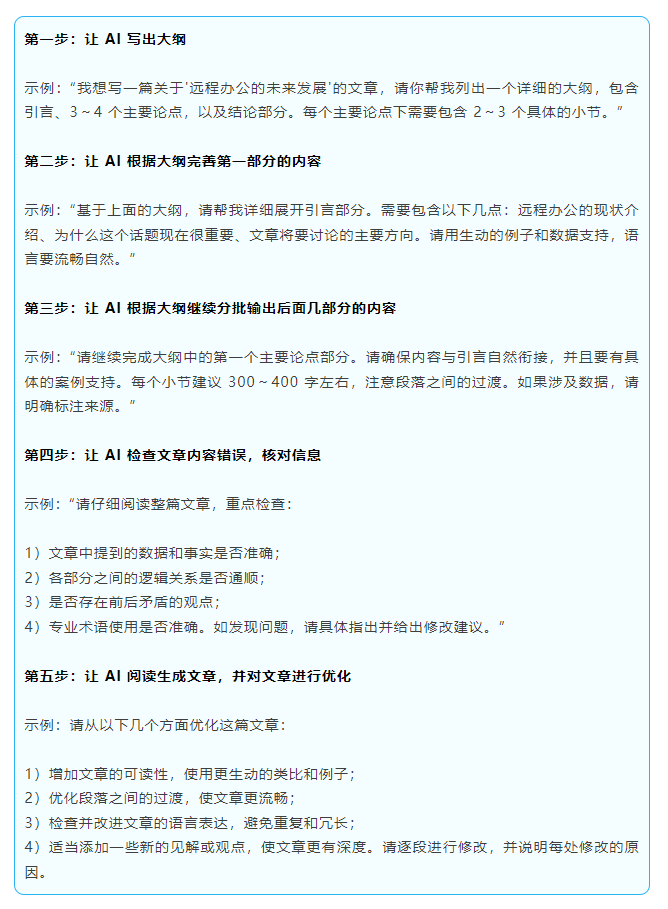

接下来用写一篇“远程办公的未来发展”的文章为例,告诉大家怎么一步步指导 AI 完成高质量写作。

三、连续提问技巧

不要指望 AI 能一次性完成你想要的内容,在使用 AI

时要调整好心态,把它当作一个博学但经验尚浅的实习生。它知识面很广,但需要你的引导才能交出令人满意的作业。

比如上面写的咖啡店的开业方案,刚产出的第一版肯定是不符合我们的需求,需要通过继续提问的方式让它优化内容,直到符合我们的要求。

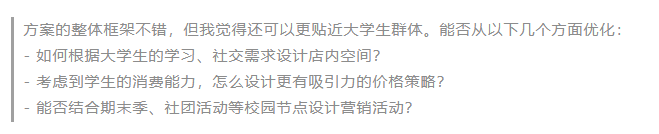

以上面咖啡店开业方案为例,DeepSeek 写的第一版方案没有很好地突出“大学生”这个目标客群。这时候,别急着否定,而是可以这样继续对话:

就像是在指导实习生,告诉他具体需要改进的方向。DeepSeek 会基于这些新的信息,对方案进行调整。

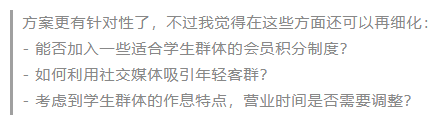

如果修改后的方案还不够完善,可以继续提问:

这个过程就像是在进行一场头脑风暴,每一轮对话都在帮助方案变得更加完善。关键是要:

1. 保持耐心,不期待一步到位

2. 给出明确的优化方向

3. 循序渐进,一个方面一个方面地改进

4. 及时总结和归纳,确保方向正确

软件特色

1、强大的语言模型:基于DeepSeek-V3模型,具备出色的语言理解和生成能力。

2、多格式支持:支持多种文件格式的上传和处理。

3、高效性与准确性:能够快速处理大量文本数据,并保证结果的准确性。

4、持续更新:模型会定期更新,以提供更优质的服务。

软件功能

DeepSeek Chat

具备对自然语言处理、问答系统、智能对话、智能推荐、智能写作以及智能客服等多项任务的支持能力。可以精准理解并有效回应用户形形色色的问题与需求,涵盖闲聊、知识查询、任务处理等诸多方面。拥有多语言支持特性,能够依据用户的语气和情绪灵活调整对话风格。还支持文件上传功能,能够扫描并读取图片或文件里的文字内容。

DeepSeek Coder

聚焦于编程代码的生成、调试与优化工作。编程能力实现大幅提升,可针对编程瓶颈问题给出多种解决方案。对代码优化及重构任务予以支持,增强代码的可读性与可维护性。模型训练成本低廉,还能支持大规模数据的处理。

DeepSeek V3

模型参数量达671亿,激活参数为37亿,基于14.8T高质量token完成预训练。其性能处于开源SOTA水准,超越Llama 3.1 405B与GPT-4o等顶尖模型,特别是在数学能力方面优势显著。而训练成本仅约558万美元,与传统模型相比大幅下降。该模型完全开源,训练细节也予以公开。

DeepSeek V2

参数量为236亿,激活参数为21亿。支持128K上下文窗口,显存消耗低,每token成本大幅降低。

DeepSeek R1

具备模型蒸馏能力,经蒸馏得到的1.5B、7B、8B、14B等小模型,极其适合本地部署,对资源有限的中小企业与开发者而言更是如此。该模型以强化学习(RL)为驱动,聚焦于数学及代码推理,支持长链推理(CoT),能很好地应用于复杂逻辑任务。

更新日志

v1.1.1版本

修复了一些BUG。

详细信息

- 文件大小:8.7MB

- 当前版本:V1.0.7

- 上线时间:2024-09-05 13:08:49